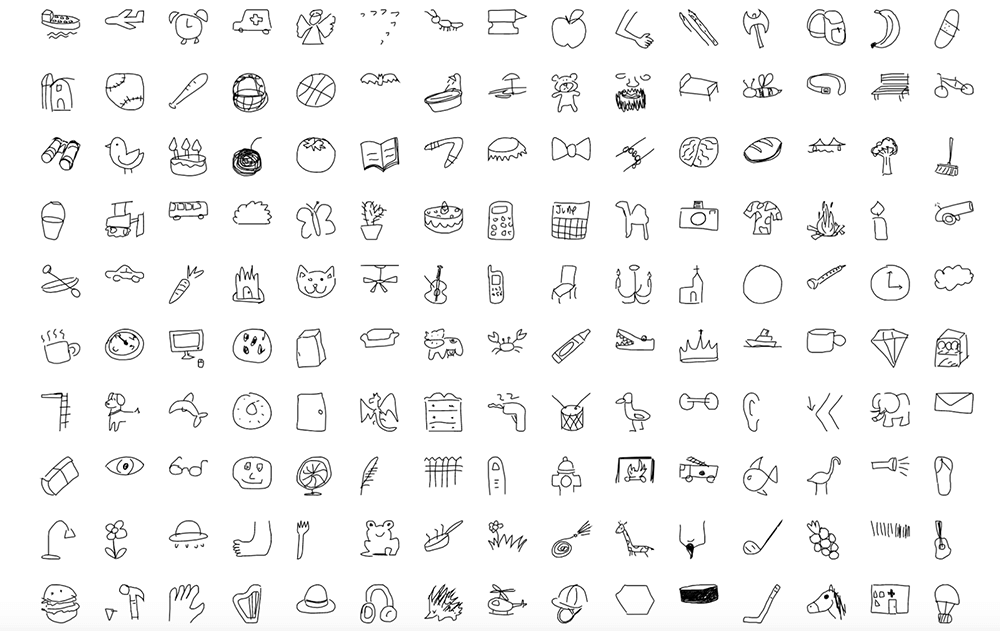

Tienes 20 segundos para dibujar un lápiz. O un gato. Con tu ratón o con tu dedo, si estás utilizando un smartphone o una tablet. Acaba cinco dibujos para completar la prueba. Si lo haces relativamente bien, una inteligencia artificial lo reconoce. Así es el sencillo juego Quick, Draw! de Google. Una pieza de software que no ha conseguido que el mundo dibuje mejor. Ha logrado entrenar a una red neuronal con 800 millones de bocetos. Pero resulta que la lección estaba cargada de sesgos.

En los últimos tiempos, decir que algo es basado en datos se ha convertido casi en sinónimo de una verdad absoluta. Los números no mienten, nos gusta creer. Sin embargo, una vez más, un experimento ha demostrado que los algoritmos de machine learning, si no se someten a ningún tipo de control, aceptarán los sesgos humanos como propios. El resultado será una inteligencia artificial que estará lejos de ser justa y equitativa.

Dibuja el futuro del machine learning

Jonas Jongejan, miembro de Google Creative Lab y anterior creativo del servicio de radiotelevisión público de Dinamarca, necesitaba un experimento sencillo para mostrar, durante un hackaton internacional, las potencialidades de la IA. Así surgió la idea de Quick, Draw! Utilizó un algoritmo creado para identificar objetos en fotos y lo adaptó para que reconociese bocetos y dibujos sencillos en tiempo real.

El resultado fue perfecto. El algoritmo funcionaba bastante bien. Y, cuando fallaba, lo hacía de una forma graciosa. Su sencillez y el toque de humor contribuyeron a su viralidad. Y en menos de seis meses, Google había convertido su experimento en una gigantesca base de datos para entrenar a su algoritmo. Un conjunto de datos de 800 millones de elementos para una red neuronal capaz de reconocer y dibujar casi cualquier objeto.

Las redes neuronales son un tipo de machine learning o aprendizaje automático. Están detrás de las herramientas de sugerencias o del reconocimiento de voz, entre otras muchas aplicaciones que utilizamos hoy en día. Mediante estos algoritmos, un ordenador es capaz de solucionar problemas por sí mismo. Lo hace infiriendo patrones de grandes conjuntos de datos. Y a mayor número de datos, mayor precisión. Pero no mayor objetividad ni equidad.

Una red neuronal de sesgos

Dibuja un zapato. Todos tenemos un esquema claro en la cabeza, ¿no? ¿Tiene tacón? ¿Es de esparto, de piel o de plástico? ¿Es marrón o de multitud de colores? Las diferencias surgen enseguida; y eso que solo hablamos de zapatos. Ahora imaginemos que se dibujaron 10 millones de zapatos para Quick, Draw! De ellos, un 80% son mocasines dibujados por hombres norteamericanos. La red neuronal pensará que el patrón más normal es este. Y nunca generará por sí misma un zapato de tacón o uno con plataforma cuando se le pregunte.

El ejemplo puede parecer exagerado. Pero no nos lo hemos inventado, al menos en su totalidad. “Cuando analizamos los más de 115.000 dibujos de zapatos en nuestra base de datos, descubrimos que un único estilo de zapato, algo parecido a una zapatilla deportiva, había sido representado en mayor medida que el resto. Como resultado, la red neuronal aprendió a reconocer solo este estilo de calzado como zapato”, explican desde Google Reena Jana y Josh Lovejoy en este artículo.

¿Y qué más dará un zapato? Ahora imaginemos que la red neuronal no está entrenada para dibujar. Sino que tiene que decidir quién es más apto para recibir un crédito. O quién se merece una beca. Qué persona tiene más probabilidades de terminar sus estudios o alcanzar mayor bienestar financiero. Si los datos están sesgados, no solo no corregiremos las desigualdades de la sociedad humana, sino que las agrandaremos todavía más.

La solución de Google

Los dibujos que genera Quick, Draw! son sencillos. Y, a veces, el algoritmo falla en reconocer cosas simples por culpa de pequeños errores en el boceto. La aplicación de Google nos enseña también que la IA está todavía en su infancia. Pero no por ello debemos ignorar el asunto de los sesgos. Sobre todo, si queremos que las máquinas tomen decisiones justas en el futuro automatizado y eficiente con el que soñamos.

La solución de Google para intentar eliminar los sesgos de su algoritmo pintor fue de todo menos automática. Mediante la aplicación open source Facets, los ingenieros etiquetaron todos los dibujos creados por humanos con valores como países o lengua hablada. Esto permitió a los ingenieros identificar qué culturas estaban sobredimensionadas en la base de datos. Una vez tuvieron los sesgos identificados en el dataset, probaron diferentes soluciones como buscar patrones comunes en busca de contenido global o aumentar el peso de datos de culturas poco representadas para lograr resultados más equitativos.

Quick, Draw! sigue permitiendo jugar con la red neuronal. Aquí puedes probarlo. Al mismo tiempo, Google ha liberado un conjunto de datos de 50 millones de dibujos para que cualquiera pueda entrenar a sus propios algoritmos. El objetivo: que la propia comunidad innove y genere aproximaciones más equitativas para el futuro del machine learning y la inteligencia de las máquinas.

En Blog Lenovo | Los sesgos de la inteligencia artificial son nuestros sesgos

Imágenes | Google Blog, Pexels