Un niño le cuenta sus problemas en el cole a Alexa. Un juez decide la responsabilidad de un coche autónomo en un atropello intencionado que ha evitado un accidente de consecuencias catastróficas. Las armas deciden por sí mismas a quién eliminar. Una de estas tres situaciones ya es real. Las otras dos son más que posibles en el futuro cercano. ¿Pueden las decisiones tomadas por sistemas amorales tener consecuencias éticas? El debate está abierto y es hora de dejar de mirar para otro lado.

Más allá del pesimismo y el optimismo

La inteligencia artificial nos salvará de todas las miserias humanas. La inteligencia artificial nos dominará y acabará con la sociedad humana tal y como la conocemos. La discusión alrededor del futuro de la IA, polarizada a nivel mediático por Mark Zuckerberg (optimista) y Elon Musk (catastrofista), tiene una amplia gama de grises.

Los sistemas autónomos e inteligentes, todavía en pañales, nos están poniendo ante grandes dudas éticas y también sociales. La robótica desplazará una buena parte de la mano de obra humana. El Internet de las Cosas pondrá en riesgo la privacidad del individuo. Las redes sociales son ya un altavoz de odio e informaciones falsas. Pero los robots y los dispositivos conectados también nos facilitan la vida y Twitter y Facebook permiten conversaciones globales antes imposibles.

¿Qué hacemos entonces? La tecnología, humana, tiene siempre más de una cara. Y está en nuestra mano hacer que su desarrollo se mantenga dentro de unos límites éticos. Esto es lo que han pensado los 250 expertos detrás del proyecto Ethically Alligned Design. Liderados por el Institute of Electrical and Electronics Engineers (IEEE) mentes destacadas del mundo de la tecnología, las leyes, las ciencias sociales, los negocios o la filosofía trabajan en desarrollar una serie de recomendaciones para afrontar las implicaciones éticas y sociales de la tecnología, en general, y la inteligencia artificial en particular.

Cinco principios incuestionables

“Los sistemas futuros de inteligencia artificial tendrán un potencial de transformación en el mundo similar al que tuvo la agricultura o la revolución industrial, el cual podría generar niveles de prosperidad sin precedentes. Sin embargo, no existen garantías de que este desarrollo vaya a ser positivo”. Así resumen parte de sus dudas los expertos. Las posibilidades parecen muchas. Alcanzar un resultado positivo para todos depende de nosotros.

De esta forma, el informe, abierto al debate y lejos aún de su versión definitiva, aborda multitud de cuestiones concretas. Por ejemplo, dedica más de 30 páginas a profundizar sobre las implicaciones éticas de las armas autónomas. Por encima de todo, en su búsqueda de dirigir el desarrollo tecnológico del futuro hacia el beneficio del mundo y los seres humanos, los expertos establecen cinco grandes principios. Cinco líneas rojas, como si de las leyes de la robótica de Asimov se tratasen, que siempre deberíamos tener presentes.

Respeto a los derechos humanos

La barrera número uno la forman los derechos humanos, un límite que, por desgracia, ya nos hemos saltado muchas veces sin ayuda de la robótica ni la tecnología. Sin embargo, desde el informe Ethically Alligned Design, consideran que son la mejor base para asegurar una buena relación entre inteligencia artificial y sociedades humanas.

Entre otras cosas, los expertos creen que es necesario:

- Establecer estándares y órganos regulatorios que vigilen el desarrollo de la IA

- Traducir las obligaciones legales de las sociedades actuales al mundo de la inteligencia artificial

- Asegurar que la IA siempre está sometida al control y al juicio humano, y nunca al revés

Priorizar el bienestar

El desarrollo de los sistemas autónomos e inteligentes debería de ir acompañado de una serie de objetivos de bienestar. No solo en lo que se refiere a mantener la estabilidad económica de las sociedades humanas, sino dirigidos a proteger el medio ambiente y las relaciones sociales. Así, se conseguiría que el desarrollo tecnológico estuviese siempre acompañado de la mejora de la situación del planeta y los seres que lo habitan.

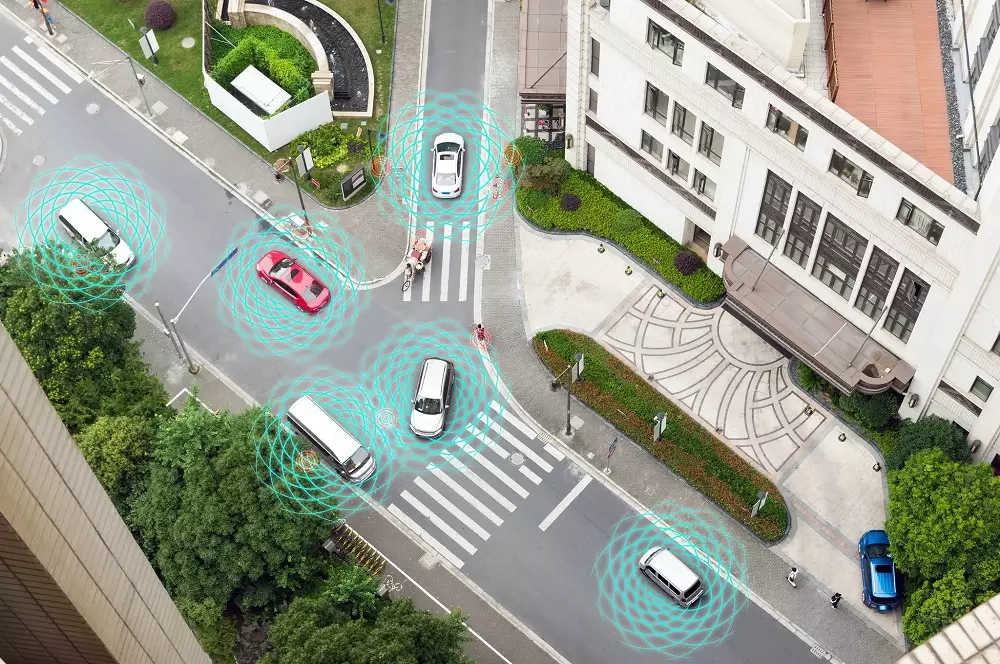

Definir la responsabilidad

Es, sin duda, una de las cuestiones más espinosas dentro de las implicaciones legales de la inteligencia artificial. Si es el propio coche el que toma las decisiones en la carretera, ¿a quién hacemos responsable si hay un accidente? Para ello, el informe recomienda:

- A legisladores: que se pongan a trabajar para clarificar aspectos como la responsabilidad, las obligaciones o la rendición de cuentas. La industria debe saber a qué atenerse.

- A desarrolladores: que tengan en cuenta la diversidad de leyes, normas y principios culturales que existen en el mundo.

- Al resto de grupos implicados: sociedad civil, fabricantes o gobiernos deberían colaborar para crear y recomendar normas allí donde no las haya.

- Registrar la actividad de la IA. Para los expertos, se hace necesario tener acceso a los datos de los sistemas autónomos que aclaren su intencionalidad, cómo funcionan o cómo interaccionan con el usuario humano.

Transparencia

Profundizando en el acceso a los datos, el informe señala que las operaciones de los sistemas autónomos deben ser transparentes. Es decir, en caso de que se produzcan problemas legales, conflictos de intereses o incidentes con los usuarios, debe ser posible acceder a estos sistemas complejos para poder entenderlos y decidir en consecuencia. “Se deben desarrollar nuevos estándares que describan niveles medibles y comprobables de transparencia para que los sistemas puedan ser evaluados objetivamente”, puntualizan los expertos.

Abuso y mal uso de la tecnología

¿Cómo reforzar los beneficios del desarrollo tecnológico y reducir los riesgos de un uso malintencionado del mismo? Para los expertos, la concienciación es clave. Un mundo consciente de los usos negativos de una determinada tecnología reaccionará más rápido y con mayor seriedad ante el mismo. Como sucede, por ejemplo, con los bulos y las fake news en las redes sociales, conocer su existencia y cómo ciertos grupos se pueden beneficiar de ella, nos ayuda a no caer en el engaño (al menos, no siempre).

Así, los principios generales del informe cierran con tres recomendaciones:

- Educar en ética y seguridad para sensibilizar a la sociedad sobre los riesgos de un mal uso de la tecnología

- Implicar a las personalidades con mayor credibilidad en el debate y darle la máxima difusión posible

- Educar a gobiernos y legisladores para que la sociedad en su conjunto se enfrente a los desafíos de forma clara, dejando a un lado miedos o confusiones sin fundamento

La tecnología nos ha permitido un desarrollo sin precedentes. Sin embargo, este desarrollo ha importado muchos de los males que llevan lastrando a la sociedad humana durante siglos. La desigualdad y el impacto severo en el medio ambiente están lejos de solucionarse. El desarrollo que está por venir y la inteligencia artificial podrían ayudarnos a ser un poquito mejores. O no. Por sí sola, la tecnología no hará ni el bien ni el mal. Está en nuestra mano convertirla en aquello que queremos.

¿Qué puedes hacer en tu día a día?

Como puedes ver, un uso ético de la tecnología es una tarea de todos. Es cierto que en la parte técnica y política debe haber una concienciación grande sobre cómo utilizar correctamente toda la tecnología presente y venidera, pero al final son los usuarios de todo el mundo los que deben poner de su parte para usar correctamente la tecnología. Por eso, si has llegado hasta aquí, puede que quieras saber algunos consejos importantes con los que usar tu tecnología más cercana de manera correcta y ética.

El primero de todos tiene que ver con el uso responsable de la inteligencia artificial. En el último año, hemos visto cambios más que importantes y sustanciales en el mundo del software, el cual aprende cada vez más rápido. No cabe duda de que un uso masivo hará que esta tecnología tenga una importancia capital en algunos aspectos, pero es importante aprender a usarla en casos de necesidad real. Y es que un uso abusivo solo dará lugar a una dependencia cada vez mayor de ella, lo que puede suponer que en el futuro se pierdan desde puestos de trabajo hasta incluso provocar una dependencia tal que no sepamos tomar decisiones o hacer planes genuinos.

Por supuesto, el teléfono móvil se ha convertido en una herramienta tan personal que es difícil no pensar en que la necesitas cerca. Y eso es un problema, ya que lo que en un principio se usaba para llamar por teléfono ahora sirve para chatear, buscar en Internet e incluso jugar. En definitiva: un pequeño ordenador en la palma de tu mano donde tienes todo lo que te gusta. Por eso es importante tiene en cuenta las herramientas de bienestar digital, las cuales te permitirán vivir más en el mundo real y no depender de lo que hay tras la pantalla.

Y aquí es donde entra en juego una labor social que tiene que ver directamente con las generaciones venideras. Y es que los usuarios más veteranos, que ya han crecido de adultos con estas y otras tecnologías, tienen la obligación de enseñar este uso ético a los más jóvenes. Muchos padres ya intentan educar a sus hijos evitando las pantallas, tanto las grandes como pequeñas, lo que puede ayudar a que todas estas jóvenes mentes se desarrollen mejor de cara al futuro sin la dependencia electrónica de la que hablábamos antes.

Llegan los chips en el cerebro ¿son el futuro o un invento pasajero?

Si hay que hablar de innovación tenemos que hablar de Elon Musk, una de las personas más influyentes del mundo de lso negocios y la tecnología. En sus manos están algunos de los proyectos más importantes para el devenir de la raza human a como es la misión a MArte, pero es verdad que todavía hay mucho camino por recorrer. También tiene su propio servicio de telefonía vía satélite, cuyo uso es muy interesante para los usuarios a los que les es imposible tener acceso a una buena conexión a Internet.

Pero uno de sus últimos proyectos tiene que ver con los chips cerebrales de Neuralink. Ya hay un paciente que es capazd de mover ratón con la mente, pero sus usos a nivel médico parecen más prometedores si cabe. Sin emabrgo, existe un dilema más que interesante con el uso de esta tecnología ya quese podría indagar aún más sobre los deseos de las personas o sus necesidades, por lo que la ética debe jugar un papel muy importante a la hora de implantar estos chips si es que en un futuro todos tendremos uno.

Lo cierto es uqe las primeras pruebas con este dispositivo han ayudado y mucho a la persona a la que se lo han implantado, por lo que podríamos hablar de cieerto éxito. Y es importante coger esto con pinzas, ya que el propio usuairo ha sufrido una pequeña deconexión de hardware en la que la propia compañía está trabajando para evitarla en su próxima versión. Por supuesto, se necesita un nuevo paciente para que lo pruebe, por lo que se están buscando voluntarios a los que puedan mejorar la vida en la medida de lo psoible con este chip electrónico con el que esperan devolver una parte de la vida perdida para estas personas. Todo eso bajo el amparo de una cosa muy importante y es la gestió nde datos, la cual confirman que son se realiza ninguna más allá de las analíticas necesarias en cada revisión.

Imágenes: IEEE, iStock