Los ordenadores están empezando a estar dotados de inteligencia, lo que les permite aprender de la misma manera que los humanos. Este salto en las capacidades de inteligencia artificial ha sido posible gracias a los incrementos masivos en datos y en potencia de computación.

Sin la increíble explosión de datos no habría sido posible que la Inteligencia Artificial avanzara tan rápido en los últimos años: cuantos más datos tiene un sistema de inteligencia artificial, más rápido puede aprender y más preciso se vuelve.

Datos que deben ser procesados

Pero, a su vez, se necesita mucha más capacidad de cálculo para procesar todos estos datos y que las máquinas puedan realizar cada vez más tareas humanas: reconocimiento facial, análisis de mensajes de las redes sociales, oir e interpretar la voz humana (con los asistentes de voz de los sistemas operativos), medir nuestras emociones (por ejemplo, la informática afectiva).

Cuanto más inteligentes se vuelven las máquinas, más pueden hacer por nosotros. Eso significa que aún más procesos, decisiones, funciones y sistemas pueden ser automatizados y llevados a cabo por algoritmos o robots.

Desde chatear con amigos en una aplicación de mensajería o comprar un café, hasta entrar y salir con una tarjeta de transporte o reproducir música… hoy casi todo lo que hacemos deja un rastro de migas de datos. Y esta datación creciente de nuestro mundo ha llevado a una explosión de datos sin precedentes.

Solo en un minuto, Facebook recibe 900.000 inicios de sesión, más de 450.000 Tweets son publicados y se envían 156 millones de correos electrónicos y 15 millones de mensajes de texto. Con números así, no es de extrañar que esencialmente dupliquemos la cantidad de datos creados en el mundo. aproximadamente cada dos años.

¿Sigue vigente la Ley Moore?

Nada de este increíble crecimiento en datos, ni los miles de millones de dispositivos conectados disponibles, serían posibles sin los enormes avances en el poder de cómputo que hemos logrado. Entre 1975 y 2015, el poder de cómputo se duplicó a una tasa de cada dos años, antes de reducirse a la tasa actual de aproximadamente cada dos años y medio.

Gordon Earle Moore, cofundador de Intel, trazó los datos sobre la cantidad de componentes (transistores, resistencias y condensadores) en chips hechos entre 1959 y 1965. Viendo la línea que se dibujaba, y haciendo una extrapolación, especuló que la cantidad de componentes aumentaría de 26 en 1965 a 216 en 1975, duplicándose cada año.

Su pronóstico de 1965-1975 se hizo realidad. En 1975, con más datos, revisó la estimación del período de duplicación a dos años. En aquellos días, los componentes doblados también duplicaban la velocidad del chip porque la mayor cantidad de componentes podía realizar operaciones más potentes y los circuitos más pequeños permitían velocidades de reloj más rápidas.

Más tarde, el colega de Moore, David House, afirmó que el tiempo de duplicación de la velocidad debería tomarse como 18 meses debido al aumento de la velocidad del reloj, mientras que Moore sostuvo que el tiempo de duplicación de los componentes fue de 24 meses. Pero la velocidad del reloj se estabilizó alrededor de 2000 porque las velocidades más rápidas causaban más disipación de calor de lo que los chips podían soportar. Desde entonces, las velocidades más rápidas se logran con chips multi-core a la misma frecuencia de reloj.

La Ley de Moore es una de las predicciones tecnológicas más duraderas que se hayan hecho. Es el emblema de la era de la información, la marcha implacable del chip de ordenador que permite una revolución técnica, económica y social nunca antes experimentada por la humanidad .

Otras leyes importantes

La Ley Moore es una de las que más afecta al sector tecnológico. Pero, tal y como señaló el futurista Ray Kurzweil en 2001, “no experimentaremos 100 años de progreso en el siglo XXI: será más como 20.000 años de progreso (al ritmo de hoy)”.

Basta pensar en cuánto han cambiado las cosas en los últimos 10 años (Internet inalámbrico, teléfonos inteligentes, Facebook y Twitter), y luego tratar de imaginar qué tan diferentes serán las cosas en 2021 o incluso en 2100.

Según Kurzweil, la Ley de Circuitos Integrados de Moore es la quinta de una serie de paradigmas de crecimiento de procesamiento de cómputo exponencial. Los cuatro paradigmas previos son: los dispositivos de cálculo mecánicos utilizados en el Censo de EE.UU. de 1890, hasta la máquina de Robinson basada en retransmisión de Turing que descifró el código de enigma nazi, hasta la computadora de CBS que predijo la elección de Eisenhower, al las máquinas basadas en transistores utilizadas en los primeros lanzamientos espaciales.

Llega la informática cuántica

Sin embargo, y volviendo a la Ley Moore, algunos consideran que estamos llegando a los límites de lo que la potencia de cómputo tradicional puede manejar.

Afortunadamente, en el horizonte, tenemos lo que se conoce como informática cuántica. Probablemente pueda ser la transformación más significativa del poder de cómputo. Esta informática cuántica verá que los ordenadores se vuelven millones de veces más rápidos de lo que son ahora.

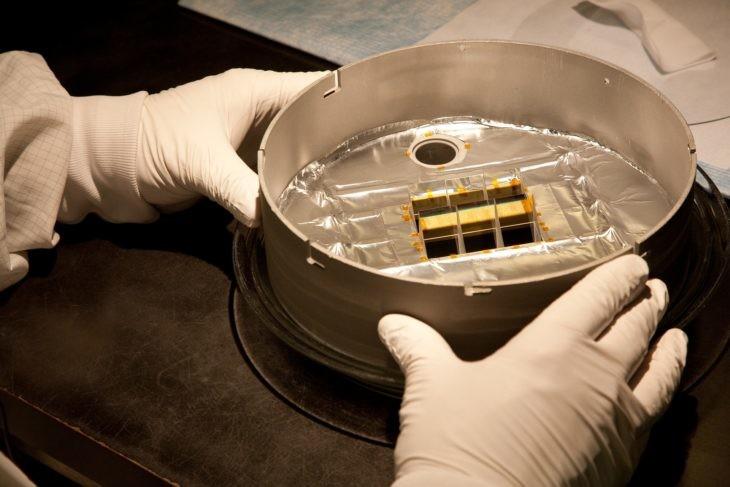

A Paul Benioff se le atribuye haber aplicado primero la teoría cuántica a los ordenadores en 1981. Benioff teorizó sobre la creación de una máquina cuántica de Turing. Las máquinas actuales, como una máquina de Turing, funcionan manipulando bits que existen en uno de dos estados: un 0 o un 1. Mientras, los ordenadores cuánticos no están limitados a dos estados; codifican información como bits cuánticos, o qubits, que pueden existir en superposición.

Los qubits representan átomos, iones, fotones o electrones y sus respectivos dispositivos de control que trabajan juntos para actuar como memoria del ordenador y procesador. Debido a que un ordenador cuántico puede contener estos estados múltiples simultáneamente, tiene el potencial de ser millones de veces más potente que las supercomputadoras más poderosas de la actualidad.

Cuándo tendremos una máquina cuántica

La industria tecnológica está en una carrera para lanzar la primera máquina cuántica comercialmente viable, capaz de resolver problemas que los ordenadores de hoy pueden manejar. Capaz, incluso, de resolver problemas que aún no podemos imaginar.

Entonces, ¿cuándo podría construirse tal dispositivo? Muchos investigadores creen que se necesitará más de una década, pero se muestran reacios a la hora de determinar una fecha con más exactitud. Algunos especulan que tal vez 20 años es una fecha más cercana a la realidad; otros son más cautelosos aún.