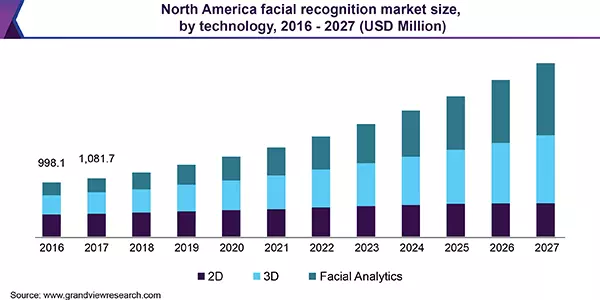

Los datos son el nuevo oro para las empresas, la materia prima sobre la que se construyen negocios millonarios: analitica facial para industria 3D, sector retail (moda, maquillaje, cuidado personal), salud, seguridad y leyes… El año pasado, la industria del reconocimiento facial era un mercado con una capitalización de 3.400 millones de dólares.

Un valor que se estima de 11.000 millones en 2025 y un crecimiento de 2020 a 2027 del 14,5%. Ya existen, de hecho, alternativas para sacar una buena comisión de todo esto. Pero la cuestión nuclear que subyace es: ¿estamos hablando de una actividad completamente ética? ¿De verdad se pueden comprar y vender datos personales sin el mejor escollo legal? ¿El data mining puede escapar de este libertinaje orwelliano, llegará el momento donde todos los ciudadanos estaremos obligados a cumplir con un rating específico?

China lleva la delantera en inteligencia facial

Comencemos por el aspecto más sugerente: nuestros rostros. Durante años, la tecnología de reconocimiento facial se limitaba a crear un mapa a partir de varias fotos tomadas desde distintos ángulos. Esta triangulación hacía uso de grandes bases de datos, pero tardaba horas o incluso días en conformar el patrón correspondiente que identificara a la persona en cuestión.

Nada que ver con las gafas del Departamento de Seguridad Pública chino, capaces de reconocer el nombre, género y todos los datos de una persona de un plumazo. Incluso su historia de internet. En 2015, se lanzó en China Sky Net, un sistema de vigilancia permanente conectado a una red de más de 24 millones de cámaras de seguridad. Si un policía busca un vehículo dentro de este servicio, al momento tendrá datos como sus inspecciones técnicas, estado de la póliza del seguro o toda la ficha del dueño y de la marca. En apenas un segundo.

El mundo ha cambiado mucho. Solo hay que echar un ojo a un producto tan mediático como las Google Glass: donde antes fracasaron por considerarlas un cacharro demasiado intrusivo, hoy son un codiciado objeto para desarrolladores.

La conciencia ética impulsa una pausa en EEUU

Por otro lado, y mientras el reconocimiento facial es cada día una tecnología más asentada y utilizada por distintas organizaciones públicas, muchos de los grandes conglomerados tecnológicos han decidido dar un paso en la dirección opuesta: Amazon anunció que su programa de reconocimiento facial Rekognition ya no sería una herramienta para la policía estadounidense —usada en aduanas, puestos fronterizos y prisiones—. Microsoft tomó la misma decisión.

Y el pasado 9 de junio, Arvind Krishna (CEO de IBM), afirmó que la compañía tampoco comercializará software de reconocimiento facial. Su carta abierta al Congreso de los Estados Unidos dejó bien claro que esta tecnología aún requiere de mayor legislación y regulación gubernamental.

El fallecimiento del afroamericano George Floyd a causa de la brutalidad policial ha llevado a muchas grandes empresas a revisar el uso que se ha dado hasta ahora a estas tecnologías: ¿viola las libertades civiles más fundamentales?

Más vigilado que legislado

La “vigilancia” es algo recurrente: desde la primera huella dactilar, Libro de Familia y el posterior DNI hasta las cámaras de circuito cerrado de los distritos comerciales, la gran mayoría de los ciudadanos formamos parte de gran un registro físico y digital. Hemos sido censados, etiquetados y archivados.

¿Y qué podríamos decir de las aplicaciones más comunes? Los vehículos de Google han registrado casi cualquier zona transitable. Google Maps contiene años de fotografías y datos con redes de carreteras, calles y avenidas de las principales ciudades y pueblos del planeta entero. Usar la geolocalización dentro de su app implica directamente registrar todos nuestros movimientos dentro de sus servicios.

Una macroencuesta realizada por la consultora KPMG a más de 2000 directivos reveló que la gran mayoría (el 92%) se muestra preocupada por el impacto negativo que pueda acarrear la falta de confianza de los usuarios en la gestión de esta información. Por supuesto, existe un Reglamento Europeo de Protección de Datos (RGPD), revisado hace un par de años, pero el uso responsable de los mismos aún cae sobre el terreno de las recomendaciones. Hay poco legislado y mucho menos penalizado.

Por la cara

Y no hay mejor ejemplo para ilustrar esto que a través de FaceApp y su contrato de uso: «Grabar cierto tipo de información de archivos de registro, incluyendo tu petición web, dirección IP, tipo de navegador usado, webs visitadas, número de clicks y la forma en que interactúas con enlaces en el servicio, nombres de dominio, páginas vistas y otro tipo de información». Esto es, y no todo, lo que recopila FaceApp, un servicio creado por el desarrollador ruso Yaroslav Goncharov y su equipo, con sede en San Petersburgo.

También se reservan una «licencia perpetua, irrevocable, no exclusiva, mundial y libre de royalties» para monitorizar, alquilar o vender esta información. O, lo que es lo mismo, cada vez que subimos una foto, esta foto puede ser compartida con cientos de empresas de terceros y no solo no podemos reclamar, sino que ya no es nuestra foto: pasa a ser propiedad intelectual de FaceApp.

Y si bien estas fotos son “borradas” de los servidores 48 h después de ser tomadas, la información contenida dentro de los metadatos EXIF se guarda para siempre. La ubicación donde fue tomada, la aplicación con la que fue tomada y la fecha cuando fue tomada, por ejemplo, quedan grabadas sobre cada archivo digital.

En 2017, FaceApp hizo furor en todo el mundo. Estrellas e influencers llenaron Instagram con su logo. Logró ser durante varias semanas la app más descargada, convirtiendo a celebrities o anónimos, por igual, en ancianos. Este 2020 ha vuelto por todo lo alto gracias su nuevo filtro, Gender Swap, que modifica el género de origen de la persona presente en la foto. Su algoritmia recurre a un tipo de inteligencia artificial conocida como red neural: cuanta más información posee, mejor hace su trabajo.

Un gran poder conlleva un gran control

Hoy día no concebimos un ordenador sin conexión a internet. Pero sí hay empresas que, cada vez más, facilitan herramientas para un control estricto de nuestros datos y una seguridad superior. Solo hace falta echar un ojo a Lenovo ThinkShield, con un lector de huellas Match-on-Chip que garantiza que la imagen biométrica de esa huella nunca sale del chip, asegurando una máxima seguridad usuario-máquina.

Estos equipos cuentan además con ThinkShutter, una cubierta para la webcam que evita intrusiones, y ThinkPad PrivacyGuard, un sistema para proteger la privacidad de la pantalla, activando un filtro bloqueador para que nadie más que el usuario pueda ver lo que hay en pantalla.

La información es un bien peligroso en según qué manos. Ya se ha demostrado que los algoritmos pueden tener prejuicios, que pueden mostrar tintes racistas replicando información racista. Razón de más para mirar con lupa y contrastar la amoralidad de la información —que no su uso y explotación—.

En España, la Secretaría de Estado de la Sociedad de la Información y la Agenda Digital ya propuso un comité de sabios para redactar un Libro Blanco sobre el cual trabajar ese código ético tan anhelado. Pero los pasos son lentos y, entretanto, la tecnología de la inteligencia facial avanza a pasos agigantados. A pesar de su utilidad incuestionable, sin barreras, esta industria puede terminar desbordando cualquier límite ético.