En los últimos años ha habido mucho bombo con respecto a la inteligencia artificial. Cuando finalmente un producto se lanza al mercado y la lavadora puede hablar con el móvil o la nevera envía emails, nos sabe a poco.

“No era para tanto”, pensamos. Probablemente porque estamos ya pendientes de la siguiente innovación. Cada vez que la inteligencia artificial alcanza un nuevo hito, nos dicen que la IA era otra cosa. Y esto a veces ilusiona y mosquea a partes iguales.

¿Por qué cada vez decimos que la IA es una cosa diferente?

Alan Turing, considerado padre de la inteligencia artificial, estaba seguro de que la IA pensaría. Que lo haría como una persona, llegado el momento. Hoy en día a eso lo llamamos superinteligencia, y solo vive en la ciencia ficción.

Sin embargo, llamamos inteligencia artificial a algoritmos como el que nos lleva a casa después del trabajo o el que nos recomienda la siguiente serie. ¿Por qué ha ido cambiando? Probablemente porque, en pleno siglo XXI, no tenemos muy claro qué es la inteligencia.

No sabemos por qué aparece la inteligencia en el cerebro humano. Tampoco como medirla de forma objetiva, qué es la razón o cómo copiarla en las máquinas. Como consecuencia de esto, a medida que aprendemos sobre el cerebro, cambiamos la definición de inteligencia.

La IA, o la inteligencia de las máquinas, nació para imitar la totalidad o partes de la del ser humano. Si cada pocos años los descubrimientos en neurociencia van cambiando los cimientos, la torre que construimos sobre ellos también lo hace.

El cerebro como caja negra todo en uno

Hace muchos años, cuando Turing y sus colegas planificaban cómo sería la IA, apenas se sabía nada del cerebro. La concepción clásica, que venía de los griegos, es que con el cerebro se podía pensar. Se sabía para qué valía el órgano, y poco más.

Copiarlo, por tanto, resultaba imposible y carente de sentido. ¿Cómo copiar una máquina (química) que no entendemos? Quizá empezando por lo básico, por animales sencillos o “poco inteligentes” es una alternativa.

Así, los primeros algoritmos eran muy robustos y hacían muy bien su trabajo. Sin embargo, también eran extraordinariamente limitados y nada flexibles. Cada programa solo realizaba un conjunto de funciones en un orden determinado. Cero plasticidad, nulo aprendizaje.

A la pregunta P1 se respondía con R1. A P2 con R2. Si se le preguntaba por P3 y la respuesta no había sido programada de antemano, el programa colapsaba. Era evidente que el cerebro humano no funcionaba así, así que era necesario innovar hacia la plasticidad.

¿Cómo llevar la plasticidad cerebral a las máquinas?

El cerebro es plástico. No plástico como material, pero sí en cuanto a su flexibilidad para aceptar nuevos programas. Un niño de unos pocos días nacido en China y llevado a España aprenderá español de forma nativa.

Ni el español ni el chino se encontraban en su ADN, pero el cerebro estaba preparado para ambos. Partiendo de esta base, la inteligencia artificial empezó a programarse de forma flexible, respondiendo a estímulos externos.

Así, una IA para conducir, que antes tenía que aprenderse todas las carreteras, cruces, señales y desvíos de todo un país, ahora “solo” tenía que aprenderse las reglas de circulación.

Combinando estas con lo que ven sus cámaras, podría conducir por sí mismo. Cuando los algoritmos empezaron a actuar en base a señales externas, todo lo anterior dejó de ser IA para ser simplemente “programas”.

¡El cerebro tiene partes! (Y programas)

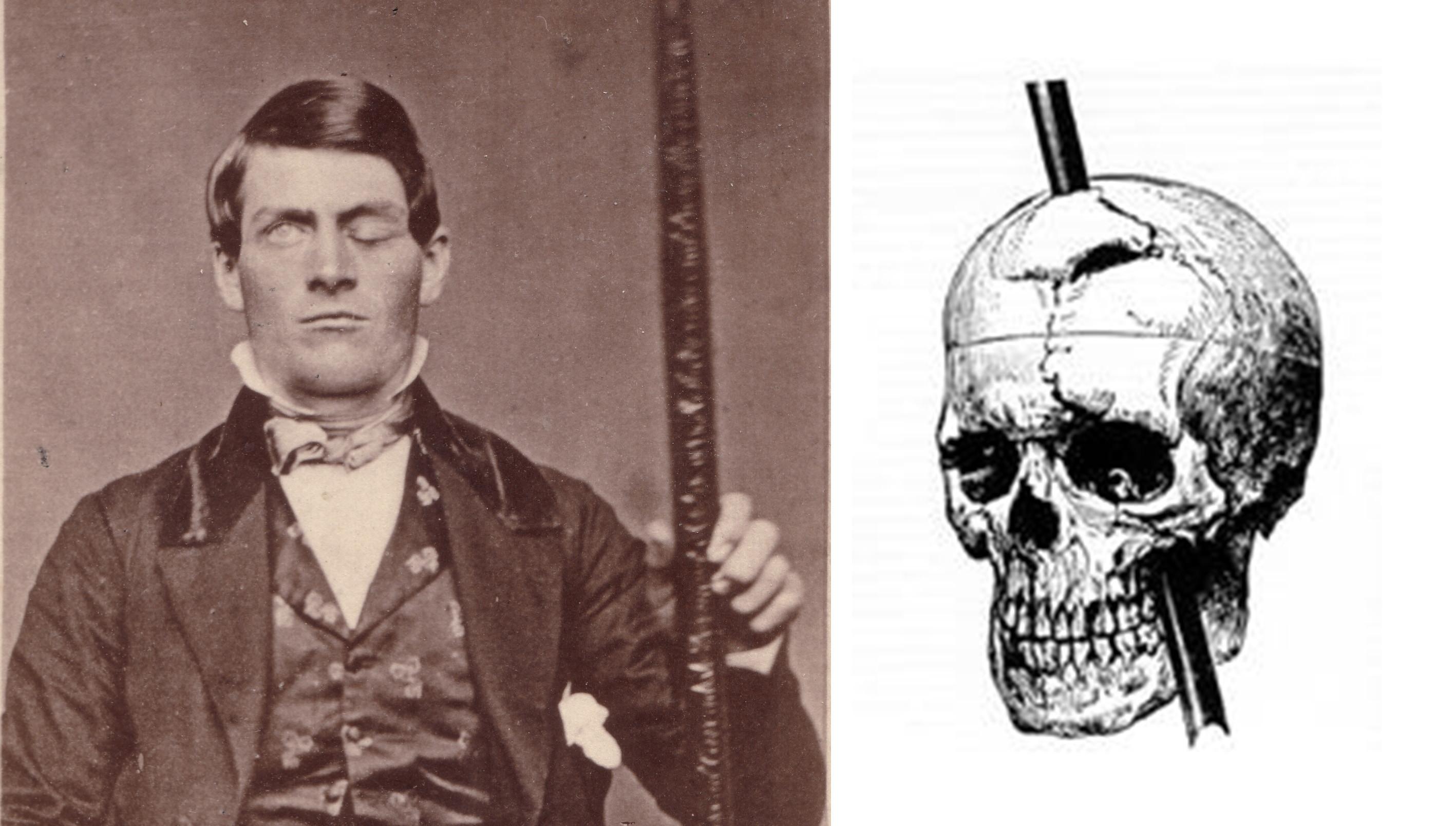

El 13 de septiembre de 1848 ocurrió un accidente que cambiaría la ciencia cerebral para siempre, y cuyas consecuencias para la IA todavía analizamos. Phineas Gage, un obrero de ferrocarriles, colocaba detonadores para perforar un agujero en la roca. Una chispa provocó una explosión y una barra de 1,1 metros de longitud salió disparada atravesándole el cráneo.

Gage sobrevivió al accidente, pero algo había cambiado. Ya no era el mismo. Su personalidad y forma de actuar había cambiado. El accidente le había convertido en otra persona, y la clave estaba en el cerebro.

Resultó que nuestro cerebro tiene zonas especializadas. “Programas” distribuidos en áreas muy específicas. Hay una zona con varios “programas” para ver, otra para oír, una más para calcular, etc.

Para funcionar correctamente es necesario que las señales especializadas lleguen a estas zonas correctas. Con esta perspectiva nacía el machine learning y las redes neuronales en las máquinas.

Las redes neuronales se formaban en base al tipo de datos recibidos y se especializaban. Si entrenamos una red neuronal para buscar vida en otros planetas y luego pretendemos que resuelva una partitura, estará perdida.

Redes en conflicto que luchan por destacar

Seguramente que alguna vez, paseando por la calle, te has topado con alguien de frente. Durante unos segundos, ambos habéis ido hacia un lado, luego hacia el otro, e incluso puede que hayáis chocado. Durante ese lapso, diferentes subrutinas de tu cerebro tiraban hacia uno u otro lado.

—¡A la derecha!

—¡No! ¡A la izquierda!

—¡He dicho a la derecha!

—¡Huye! ¡Parece un depredador!

En otro ejemplo, bajas a la calle y caminas unos minutos antes de darte cuenta de que no llevas el móvil encima. Te giras, caminas unos pasos, vuelves a girarte y continúas el camino. Vuelves. Vas.

—Oh, no, ¡el móvil!

—Da igual, tengo el de la oficina.

—Pero, ¿y si me llama mi madre?

—No pasa nada por estar unas horas desconectado.

—¡A ver si se va a preocupar!

—Venga, la llamas nada más llegar a la ofi.

Este tipo de dicotomías son muy frecuentes, y a menudo cambiamos de opinión múltiples veces en poco tiempo. El por qué es debido a que el cerebro se ha especializado en resolver muchas veces un mismo problema de manera simultánea, dando como resultado varias soluciones a la vez. Muchas de ellas contrapuestas.

Estudiando estos fenómenos, los programadores dieron con las redes neuronales convolucionales, que imitan nuestros “programas” en conflicto. Así, cuando una IA con estas redes toma una decisión, esta es la solución final resultado de una lucha por el control.

¿El futuro de la IA?

A medida que aprendemos sobre el cerebro humano tenemos más claro qué es la inteligencia, en qué consiste la percepción, cómo surge la consciencia o en qué punto la información colapsa en conocimiento y este en sabiduría. El cerebro y la inteligencia no es un campo fácil, ni mucho menos, pero empezamos a entenderlo.

Sus definiciones y significados van cambiando. La inteligencia artificial trota por detrás intentando seguir el paso. También va cambiando y mejorando a medida que aprendemos por qué somos como somos. De ahí que, cada vez que la IA alcanza un nuevo hito, dicen que la IA en realidad es otra cosa.

En Lenovo | Quieren ponerte un chip en el cerebro. ¿Te dejas?

Imágenes | istock/Kameon, iStock/antoniokhr, John M. Harlow, M.D., iStock/master1305